O futuro da inteligência artificial: desafios e oportunidades

O progresso rápido da inteligência artificial (IA) tem levado algumas vozes importantes no campo a pedir uma pausa na pesquisa, levantando a possibilidade de extinção humana impulsionada pela IA e até mesmo solicitando regulamentação governamental. No cerne de sua preocupação está a ideia de que a IA pode se tornar tão poderosa que perderemos o controle sobre ela. Mas será que estamos ignorando um problema mais fundamental?

Em última análise, os sistemas de IA devem ajudar os humanos a tomar decisões melhores e mais precisas. No entanto, mesmo as ferramentas de IA mais impressionantes e flexíveis de hoje – como os grandes modelos de linguagem por trás do ChatGPT – podem ter o efeito oposto. Por quê? Eles têm duas fraquezas cruciais. Eles não ajudam os tomadores de decisão a entenderem causação ou incerteza. Além disso, eles criam incentivos para coletar enormes quantidades de dados e podem encorajar uma atitude negligente em relação à privacidade, aspectos legais, éticos e riscos.

ChatGPT e outros “modelos fundamentais” utilizam uma abordagem chamada aprendizado em profundidade para analisar enormes conjuntos de dados e identificar associações entre fatores contidos nesses dados, como padrões de linguagem ou links entre imagens e descrições. Consequentemente, eles são ótimos em interpolação – ou seja, prever ou preencher as lacunas entre valores conhecidos.

A interpolação não é o mesmo que criação. Ela não gera conhecimento nem insights necessários para tomadores de decisão que operam em ambientes complexos. No entanto, essas abordagens exigem enormes quantidades de dados, incentivando as organizações a reunir enormes repositórios de dados ou a explorar conjuntos de dados existentes coletados para outros fins. Lida com “big data” traz consideráveis riscos em termos de segurança, privacidade, legalidade e ética.

Em situações de baixo risco, previsões baseadas em “o que os dados sugerem que acontecerá” podem ser incrivelmente úteis. Mas quando os riscos são maiores, precisamos responder a mais duas perguntas. O primeiro é: “o que está impulsionando esse resultado?” O segundo é sobre o nosso conhecimento do mundo: “quão confiantes estamos nisso?”

Os sistemas de IA projetados para inferir relações causais não precisam necessariamente de “big data”. Em vez disso, eles precisam de informações úteis. A utilidade da informação depende da pergunta em questão, das decisões enfrentadas e do valor que atribuímos às consequências dessas decisões. Por isso, é importante desenvolver técnicas de IA que nos digam o que genuinamente não sabemos, em vez de produzir variações do conhecimento existente.

Uma solução possível é iniciar um processo com sistemas de IA projetados para aprendermos o que realmente não sabemos, ao invés de produzir variações do conhecimento já existente. Esses sistemas são capazes de adquirir informações valiosas em uma sequência que nos permitirá desvendar causas e efeitos.

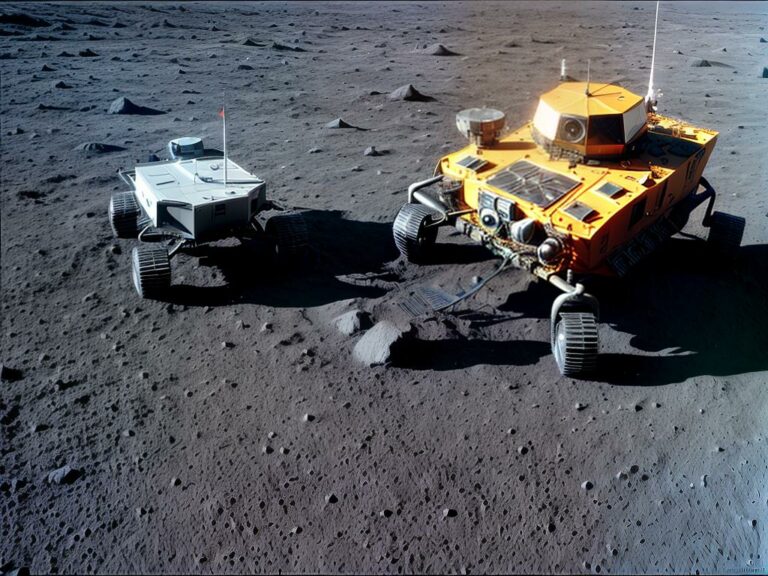

Uma abordagem semelhante à utilizada por um robô na Lua pode ser aplicada a sistemas de tomada de decisão em governos ou indústrias. Assim como o robô busca maximizar seu aprendizado sobre a superfície da Lua, os tomadores de decisão buscariam explorar e mapear paisagens sociais ou econômicas desconhecidas.

Para isso, é necessário formular perguntas iniciais, construir um mapa conceitual preliminar com base no conhecimento existente, incorporar diferentes fontes de informação e, com base na análise informando preferências da comunidade e das partes interessadas, tomar uma decisão sobre as ações a serem implementadas em determinadas condições. Esse processo envolve aprender, discutir, atualizar crenças e repetir o processo.

Onde a IA pode ser útil é na identificação do que é mais valioso em termos de informações precisas através de algoritmos que quantificam o que não sabemos. Sistemas automatizados também podem coletar e armazenar essas informações em um ritmo e lugares em que pode ser difícil para.

| Resumo da Notícia |

|---|

| O rápido progresso da inteligência artificial (IA) tem levado a pedidos de pausa na pesquisa e regulamentação governamental. No entanto, os sistemas de IA têm duas fraquezas cruciais: falta de compreensão de causação e incerteza, e incentivo à coleta excessiva de dados e negligência em relação à privacidade e ética. |

| Os grandes modelos de linguagem, como o ChatGPT, são ótimos em interpolação, preenchendo lacunas entre valores conhecidos, mas não geram conhecimento ou insights necessários para tomadores de decisão em ambientes complexos. |

| Em vez de depender de “big data”, é importante desenvolver técnicas de IA que nos digam o que genuinamente não sabemos, para inferir relações causais e obter informações úteis. Isso pode ser alcançado através de sistemas de IA projetados para aprender o que realmente não sabemos. |

| Uma abordagem semelhante à utilizada por um robô na Lua pode ser aplicada a sistemas de tomada de decisão, buscando explorar e mapear paisagens sociais ou econômicas desconhecidas. |

| A IA pode ser útil na identificação do que é mais valioso em termos de informações precisas, quantificando o que não sabemos e coletando essas informações de forma automatizada. |

Com informações do site Yahoo News.